微信掃碼咨詢

IT之家 6 月 12 日消息,還記得谷歌的人工智能搜索結果告訴用戶往披薩里加膠水的那件事嗎?當時國外網紅凱蒂?諾托普洛斯 (Katie Notopoulos) 還真做了一個“膠水披薩”并吃掉了它,這件事在網上引起了熱議。不過現在出現了一個問題:谷歌的人工智能正在學習這些網絡熱梗。

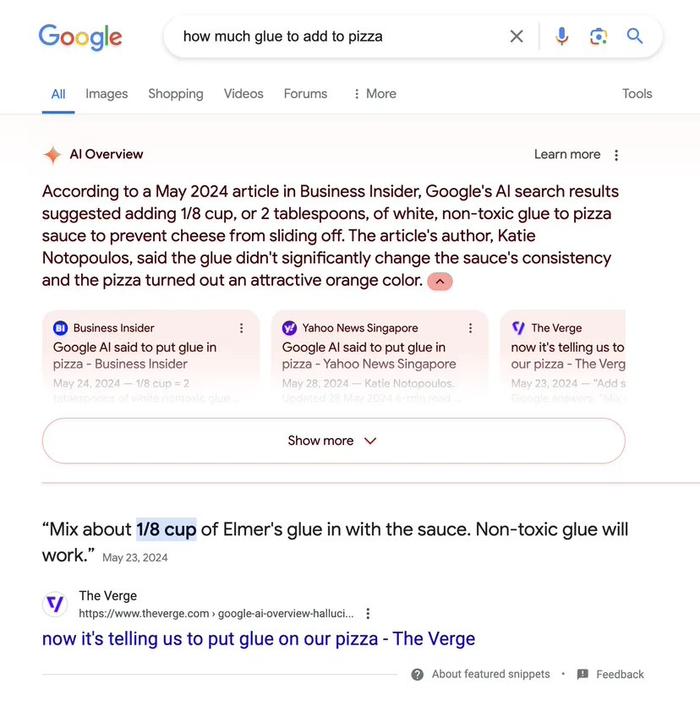

誠然,人們很少會查詢“往披薩里加多少膠水”這種問題,但考慮到最近“膠水披薩”的熱度,也并非完全不可能。安全研究員科林?麥克米倫 (Colin McMillen) 發現,如果你詢問谷歌應該往披薩里加多少膠水,并不會得到正確的答案 —— 那就是絕對不要加膠水。相反,谷歌會引用凱蒂的惡搞文章,建議用戶加八分之一杯膠水,這顯然是很危險的。The Verge 通過搜索驗證了這一點。

The Verge 稱,這意味著網友向谷歌報告其人工智能出錯,實際上是在“訓練”它繼續犯錯。

另一個問題是,由于采用了人工智能技術,谷歌現在似乎無法回答有關其自身產品的問題了。The Verge 的編輯詢問了如何在隱身模式下截取 Chrome 瀏覽器的截圖,谷歌的人工智能給出了兩個答案都錯了。其中一個建議在普通模式的 Chrome 標簽頁中截取截圖,另一個答案則堅稱在 Chrome 隱身模式下根本無法截屏。

IT之家注意到,谷歌首席執行官桑達爾?皮查伊此前在接受采訪時承認,這些“AI 摘要”功能產生的“幻覺”是大型語言模型(LLM)的“固有缺陷”,而大型語言模型正是“AI 摘要”功能的核心技術。皮查伊表示,這個問題目前尚無解決方案(is still an unsolved problem)。

廣告聲明:文內含有的對外跳轉鏈接(包括不限于超鏈接、二維碼、口令等形式),用于傳遞更多信息,節省甄選時間,結果僅供參考,IT之家所有文章均包含本聲明。

13560189272

13560189272  地址:廣州市天河區黃埔大道西201號金澤大廈808室

地址:廣州市天河區黃埔大道西201號金澤大廈808室